NVIDIA V100 SXM2 กลายเป็นทางเลือกใหม่สำหรับรัน Local LLM ราคาประหยัด

NVIDIA V100 SXM2 กลายเป็นทางเลือกใหม่สำหรับรัน Local LLM ราคาประหยัด

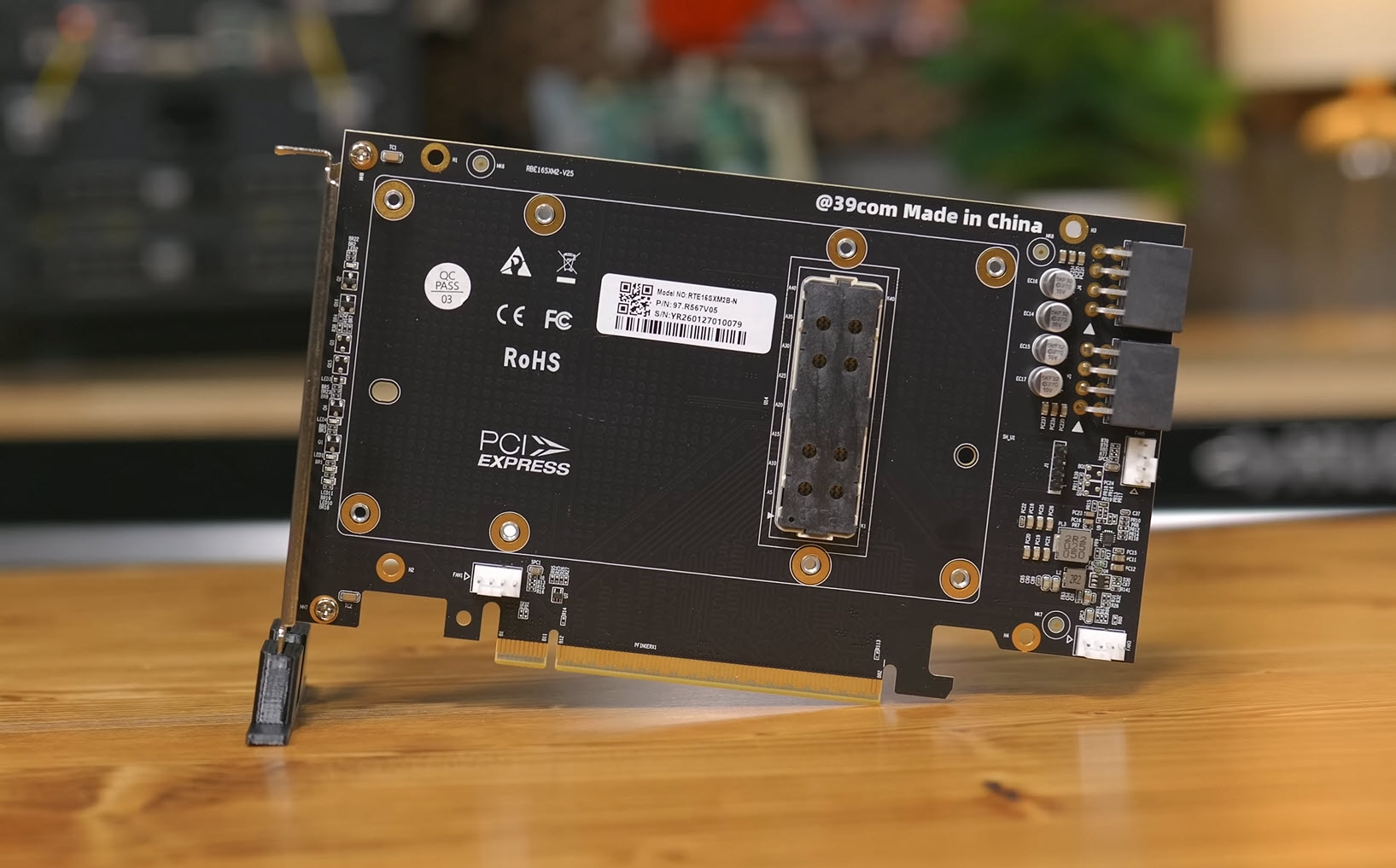

สาย Self-Hosted AI กำลังให้ความสนใจกับ NVIDIA V100 รุ่น SXM2 หลังมีการค้นพบว่าสามารถนำ GPU ระดับ Data Center รุ่นเก่ามาใช้งานบนเมนบอร์ดทั่วไปผ่านอะแดปเตอร์แปลง PCIe ได้ในราคาประหยัด

V100 เป็น GPU สถาปัตยกรรม Volta ที่เปิดตัวมาตั้งแต่ปี 2017 โดยรุ่น SXM2 เดิมถูกออกแบบมาสำหรับเซิร์ฟเวอร์ AI และระบบ Data Center ไม่สามารถเสียบใช้งานผ่านสล็อต PCIe แบบทั่วไปได้โดยตรง

อย่างไรก็ตาม มีผู้ใช้งานจากช่อง Hardware Haven ทดลองนำ V100 SXM2 ขนาด 16GB มาใช้งานผ่านบอร์ดแปลงเฉพาะทาง ซึ่งรวมต้นทุนทั้งหมดราว 200 ดอลลาร์สหรัฐ หรือประมาณไม่กี่พันบาทเท่านั้น

เมื่อเปรียบเทียบกับ NVIDIA RTX 3060 12GB พบว่า V100 ยังสามารถรันโมเดล LLM สมัยใหม่ได้ดี และมีอัตรา Tokens/sec สูงกว่าเล็กน้อย รวมถึงมีประสิทธิภาพต่อวัตต์ที่ดีกว่าในบางสถานการณ์

ท่านสามารถเข้าไปดูคลิปเต็มได้ที่ https://www.youtube.com/watch?v=7DAPd5MGodY&t=1s

ที่มา: Hackaday / Hardware Haven